在现代研究的广阔领域,人类行为的复杂性与人工智能的无限潜力相遇,ChatGPT 等工具为社会科学研究人员提供了一个迷人的途径,可以更深入地研究人类认知和社会动态的复杂性。

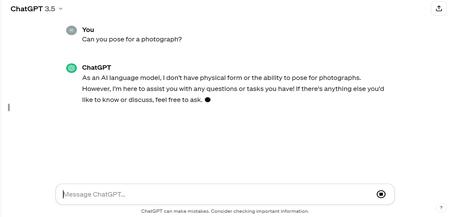

这听起来有趣吗?听起来有用吗? 听起来像是人写的吗?

上面的第一句话是由 ChatGPT 3.5 编写的,提示为一所大学的网站制作一个故事的介绍,内容是关于这种流行的生成式 AI 大型语言模型在帮助社会科学研究人员工作方面的潜力。

现在,说实话,我认为我本可以做得更好。首先,这有点夸张。它是间接的,过长的,没有抓住读者的注意力。它还使用了陈词滥调的短语“深入研究”和太多我钦佩的作家教我避免的 hifalutin 形容词。例如,像“hifalutin”这样的词。

但是,最近由社会与政策研究所(ISPS)、托宾经济政策中心和耶鲁大学新成立的数据密集型社会科学中心(DISSC)主办的培训课程强调了一个似乎不可避免的新现实:每个人都应该学习如何将人工智能纳入他们的工作,否则就有可能被抛在后面。

“不管你喜不喜欢,这些现在都是必不可少的技能,”斯坦福大学医学院高级数据科学家安东尼·罗斯(Antony Ross)说,他领导了培训课程。

在讨论生成式人工智能的新应用和不断发展的应用时,罗斯经常发现自己在转述他的同事李飞飞,他是斯坦福大学计算机科学系的首任红杉教授,也是斯坦福大学以人为本的人工智能研究所的联合主任。

“人工智能不会取代人类,”他说。“使用人工智能的人将取代不使用人工智能的人。

ChatGPT 等生成式 AI 工具经过大量数据训练,能够用通俗易懂的语言与用户交流,可以在几秒钟内总结研究论文和整个知识领域。

ChatGPT 可以将一种计算机语言翻译成另一种计算机语言。它可以帮助预测趋势,并根据目标受众或您指示它采用的角色来改变其响应的内容和语气。

最新的基于订阅的版本可以从数据输入或文本描述创建图表和图像。它可以教你如何下摆衣服或帮助准备工作面试。或者只是提供一个共鸣板来完善您对任何主题的思考,甚至口头回应口头提示。

“假设你想复习一个主题,因为你对它了解不多,或者你已经很久没有上过课了,想确保你有基础知识,”他说。“ChatGPT 就像让专家、学生或同事坐在你旁边。有人可以反弹想法。

ISPS 主任、斯特林政治学教授、DISSC 联合教职主任 Alan Gerber 参加了 ChatGPT 培训。他说,这次会议让他对这项技术的能力有了新的认识,ISPS将继续组织和资助人工智能课程。

“ISPS的核心使命是支持整个大学的社会科学研究人员获得他们所需的知识,以保持在各自领域的前沿,”他说。“了解如何使用人工智能是每个研究人员现在都需要知道的事情。

耶鲁大学环境学院的博士后简·哈勒姆(Jane Hallam)参加了DISCC培训课程,并赞扬了罗斯的见解和有用的例子。她曾使用人工智能来调试代码,并希望更多地了解该技术如何增强她的研究。但她有顾虑。

“也许我这一代人还不觉得将这种工具用于任何基于文本的输出都不太舒服,”哈勒姆说,对学术诚信的影响感到不安。“但我可以看到它的价值,它有助于为研究论文的摘要或结构提出想法。

哈勒姆说,她还可以看到使用ChatGPT之类的东西来帮助创建教材的潜力,包括试题。

“无论如何,在向任何类型的观众展示它之前,我肯定会仔细检查它产生的任何东西,”她说。

罗斯同意了。

“我认为最重要的是,它应该放大你所做的事情,而不是取代人类,”他说。“您应该始终查看输出。审查它给你的东西。

像 ChatGPT 这样的工具从大量的数字内容中汲取灵感,学习如何预测句子中的下一个单词。他们可以充当专家,但实际上并不理解他们生产的产品。此外,它们容易产生所谓的幻觉。他们可以简单地编造东西。

“我告诉学生,它就像一个孩子——它只是想取悦父母,”罗斯说,并补充说最新版本的 ChatGPT 不会像早期版本那样产生幻觉。“如果它不知道答案,它就会拼凑一些东西。

9月,教务长办公室向耶鲁大学社区分发了使用生成式人工智能工具的指南,包括保护机密信息、遵守学术诚信准则和大学行为标准以及审查内容是否存在偏见和不准确之处。

在谈到最后一点时,罗斯说,用户应该要求 ChatGPT 引用其来源。在整个培训课程中,他提供了学生、博士后研究员、教职员工如何与软件交互以制作和完善有效提示的示例。

他建议从简单开始,然后尝试各种迭代,以更好地将输出调整到特定目标。例如,用户可以要求一个假设特定先验知识或没有先验知识的响应。他们可以要求让一些事情听起来更令人兴奋或更正式。他们可以要求扩展一个点或达到精确的字数。

Ross 描述了要求 ChatGPT 为特定受众定制回复的价值。你可以要求它向你解释机器学习,就好像你在五年级一样。或者把你描述成本杰明·富兰克林(Benjamin Franklin)一样描述互联网。您可以扭转动态并让它向您提问,例如,让聊天机器人充分了解您的需求,以帮助确定购买新智能手机的最佳选择。

此外,Ross 鼓励与会者让 ChatGPT 采用特定的角色。您可以要求它充当营养师并帮助评估您的饮食。你可以要求它作为一个专家政治学家来总结该领域的最新发展。然后你可以上传整个文档供它分析、总结、编译成要点、整理成表格,挖掘构建各种难度的多项选择题,并附有正确答案。

罗斯说,关键是要不断参与和完善。您甚至可以让聊天机器人建议如何优化您正在喂养的提示。

“当你看到它的反应时,你可以更好地了解它如何看待世界,”他说,并指出,虽然 ChatGPT 3.5 不知道 2021 年 9 月之后发生的任何事情,但 4.0 版本将知识扩展到 2023 年 4 月,并且可以访问互联网以获取更多最新事件的详细信息。“通过与模型来回跳舞,你可以更好地了解它能做什么,它可以更好地理解你真正想要实现的目标。

DISSC 主任 Ron Borzekowski 计划就各种主题举办更多培训课程。今年春天晚些时候,将为政治学研究人员举办另一场关于人工智能大型语言模型的课程。

“随着我们继续建设该中心,我们希望为我们广泛的研究社区的成员提供更多机会,让他们能够获得和了解如何最好地参与最有效的工具来推进他们的工作,”他说。“人工智能产品肯定会成为这个不断增长的名单之一。

托宾中心教职主任史蒂文·贝瑞(Steven Berry),大卫·斯文森(David Swensen)经济学教授,DISSC的联合教职主任,与Gerber和Ross对这种快速发展的技术的普遍热情相呼应。

“我们当然需要应对人工智能带来的道德和技术挑战,”贝瑞说。“但我们也应该接受它帮助研究的能力。我很高兴托宾中心、ISPS 和 DISSC 能够帮助驾驭这个不断变化的环境。

耶鲁大学环境学院(Yale School of the Environment)研究学者、工业生态学常驻研究员里德·利夫塞特(Reid Lifset)参加了培训课程,部分原因是为了更多地了解ChatGPT如何通过帮助用户一次搜索多篇论文的内容来加速对当前研究的理解。他还帮助领导了一个项目,调查包括人工智能在内的数字经济对环境的影响。

“已经对训练这些计算密集型模型所需的资源进行了一些研究,”Lifset说。“它们需要大量的电力,因此需要大量的碳排放。正在进行的研究旨在了解如何改变这些模型的编码和设计,以提高能源效率。

罗斯提出了另一个担忧,涉及大型语言模型反映和放大现有种族和性别偏见的趋势。例如,除非另有提示,否则他们可能会生成浅色皮肤的人的图像。

罗斯说,尽管人工智能将越来越多地威胁就业,努力保护版权,并促进错误信息和网络犯罪的传播,但它不会消失。研究人员和学生可以学会防范其风险,同时拥抱其可能性。

“这就是我们人类经常错过的东西,”罗斯说。“这些人工智能模型知道数万亿个答案。他们已经看到了这一切。对于人们来说,如果你擅长你所做的事情,你就可以变得更好。

接收有关ISPS活动的时事通讯或其他公告

在这里订阅

新闻旨在传播有益信息,英文版原文来自https://isps.yale.edu/news/blog/2024/03/did-ai-write-this-headline-yale-provides-training-to-use-chatgpt-for-social