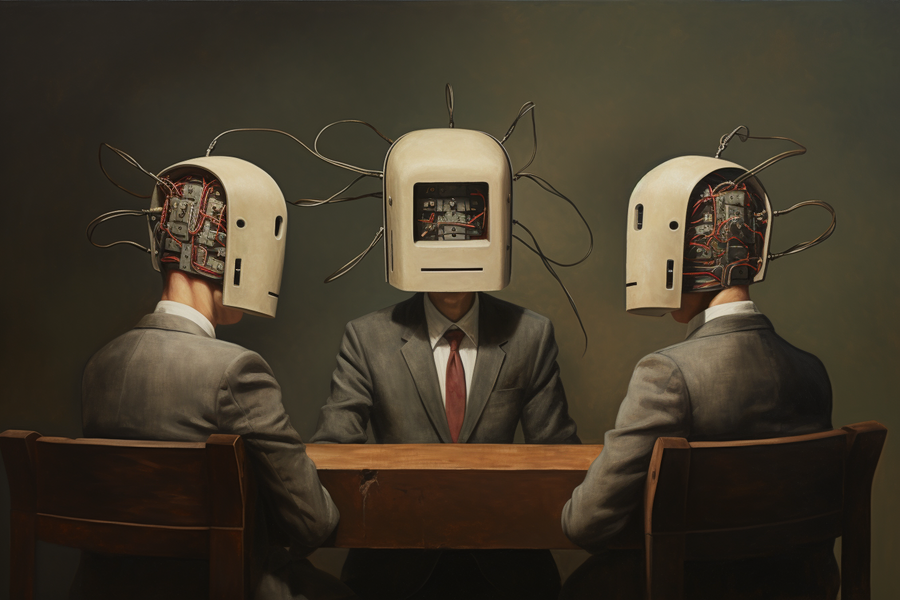

在我们成长的岁月里,经常向我们介绍一句古老的格言,旨在推动我们超越以自我为中心的新生思想:“两个脑袋总比一个好。这句谚语鼓励协作思维,并突出了共享智力的效力。

快进到 2023 年,我们发现即使在人工智能领域,这种智慧也适用:多种语言模型,和谐工作,比一种更好。

最近,麻省理工学院计算机科学与人工智能实验室(CSAIL)的一个团队在现代技术的前沿体现了这种古老的智慧。他们引入了一种策略,利用多个人工智能系统相互讨论和争论,以就给定问题的最佳答案达成一致。这种方法使这些广泛的语言模型能够提高他们对事实数据的依从性并完善他们的决策。

大型语言模型(LLM)问题的症结在于其生成的响应不一致,导致潜在的不准确和有缺陷的推理。这种新方法允许每个代理主动评估其他代理的反应,并利用这种集体反馈来完善自己的答案。从技术上讲,该过程包括多轮响应生成和批评。每个语言模型都会生成给定问题的答案,然后合并来自所有其他代理的反馈以更新其自己的响应。这个迭代循环最终导致模型解决方案的多数投票的最终输出。它在某种程度上反映了小组讨论的动态——个人为得出统一和合理的结论做出了贡献。

该方法的真正优势在于它无缝应用于现有的黑盒模型。由于该方法围绕生成文本展开,因此也可以在各种LLM中实施,而无需访问其内部工作原理。该团队表示,这种简单性可以帮助研究人员和开发人员使用该工具全面提高语言模型输出的一致性和事实准确性。

“采用一种新颖的方法,我们不仅仅依靠单一的人工智能模型来获得答案。相反,我们的流程招募了大量人工智能模型,每个模型都带来了独特的见解来解决问题。虽然他们的初始反应可能看起来被截断或可能包含错误,但这些模型可以通过仔细检查同行提供的回答来锐化和改进自己的答案,“麻省理工学院电气工程和计算机科学博士生Yilun Du说,麻省理工学院CSAIL的附属机构,以及一篇关于这项工作的新论文的主要作者。“当这些人工智能模型参与讨论和审议时,他们能够更好地识别和纠正问题,提高解决问题的能力,并更好地验证他们回答的准确性。从本质上讲,我们正在营造一种环境,迫使他们深入研究问题的症结。这与单一的、孤立的人工智能模型形成鲜明对比,后者经常鹦鹉学舌地模仿互联网上的内容。然而,我们的方法会积极刺激人工智能模型,以制定更准确、更全面的解决方案。

该研究着眼于数学问题的解决,包括小学和初中/高中数学问题,并通过多智能体辩论过程显着提高了表现。此外,语言模型展示了生成准确算术评估的增强能力,说明了不同领域的潜力。

该方法还可以帮助解决经常困扰语言模型的“幻觉”问题。通过设计一个让智能体互相批评对方反应的环境,他们更有动力避免吐出随机信息并优先考虑事实的准确性。

除了应用于语言模型之外,该方法还可用于将各种模型与专业功能集成在一起。通过建立一个分散的系统,让多个代理进行交互和辩论,他们有可能在语音、视频或文本等各种形式中使用这些全面而高效的解决问题的能力。

虽然该方法产生了令人鼓舞的结果,但研究人员表示,现有的语言模型可能会面临处理非常长的上下文的挑战,并且批评能力可能没有预期的那么精细。此外,受人类群体互动启发的多智能体辩论形式尚未纳入有助于智能集体决策的更复杂的讨论形式 – 这是未来探索的关键领域,该团队说。推进该技术可能涉及更深入地了解人类辩论和讨论背后的计算基础,并使用这些模型来增强或补充现有的LLM。

“这种方法不仅提供了提高现有语言模型性能的途径,而且还提供了一种自我改进的自动手段。通过将辩论过程用作监督数据,语言模型可以自主增强其真实性和推理能力,减少对人类反馈的依赖,并提供一种可扩展的自我改进方法,“杜说。 ”随着研究人员不断完善和探索这种方法,我们可以更接近未来,语言模型不仅可以模仿类似人类的语言,还可以表现出更系统和可靠的思维, 开创语言理解和应用的新时代。

“使用审议过程来改善模型的整体输出是非常有意义的,这是从思维链提示向前迈出的一大步,”加州大学伯克利分校电气工程和计算机科学系副教授Anca Dragan说,他没有参与这项工作。“我对接下来的发展感到兴奋。当人们看到审议时,他们能否更好地判断LLM的答案,无论它是否趋同?人们可以通过自己与LLM进行审议来得出更好的答案吗?可以使用类似的想法来帮助用户探索LLM的答案,以便得出更好的答案吗?”

杜与三个CSAIL附属机构一起撰写了这篇论文:李爽SM ‘ 20,PhD ‘ 23;麻省理工学院电气工程和计算机科学教授安东尼奥·托拉尔巴;麻省理工学院计算认知科学教授和大脑、思维和机器中心成员约书亚·特南鲍姆。谷歌DeepMind研究员Igor Mordatch也是合著者。

新闻旨在传播有益信息,英文版原文来自https://news.mit.edu/2023/multi-ai-collaboration-helps-reasoning-factual-accuracy-language-models-0918