那些为人工智能设计深度神经网络的人经常从人类大脑中获得灵感。大脑更重要的特征之一是它是一个“嘈杂的”系统:并不是每个神经元都包含完美的信息,这些信息以完美的清晰度通过突触传递。有时部分或相互冲突的信息被大脑转化为行动,有时部分信息直到随着时间的推移积累了更多的信息才会起作用。

加州大学圣巴巴拉分校电子与计算机工程教授德米特里·斯特鲁科夫实验室的五年级博士生穆罕默德·雷扎·马穆迪解释说:“这就是为什么当你在不同的时间用相同的输入刺激大脑时,你得到的反应是不同的。”“嘈杂、不可靠的分子机制是对重复出现的相同刺激产生本质不同的神经反应的原因,而重复出现的相同刺激又允许复杂的随机或不可预测的行为。”

人类的大脑非常善于填补缺失信息的空白,并通过对噪音的分类来得出准确的结果,因此“无用输入”并不一定会产生“无用输出”。事实上,Mahmoodi说,大脑在处理嘈杂信息时表现得最好。在随机计算中,噪声被用来训练神经网络,使其“正则化”以提高其鲁棒性和性能。

Mahmoodi解释说,目前还不清楚在什么理论基础上,涉及知觉过程的神经元反应可以被分为“噪音”和“信号”,但大脑中计算的噪音性质激发了随机神经网络的发展。这些现在已经成为解决机器学习,信息论和统计学问题的最先进的方法。

“如果你想要一个随机系统,你必须产生一些噪声,”Mahmoodi和他的合著者,Strukov和Mirko Prezioso,在一篇论文中描述了一种创造这样一个噪声系统的方法。“基于非易失性记忆的通用随机点积电路用于高性能神经计算和神经优化”发表在最近一期的《自然通讯》杂志上。

最著名的基于随机计算的网络是所谓的“玻尔兹曼”机器,它可以解决复杂的组合优化问题。这类问题的特点是有无数可能的合理的解决方案,但没有一个是绝对最好的解决方案。旅行推销员问题是一个著名的例子,即一个推销员为了推销产品必须经过美国的每一个州,但他必须走尽可能短的路线。

没有明确的最佳,完美的解决方案存在,因为空间是如此之大,可能的路线组合在它几乎是无限的。然而,Mahmoodi指出,“你可以使用神经网络和启发式算法来找到一种半优化的解决方案。重要的是,你能在合理的时间内得到良好的回应。”

这可以通过应用一种被称为“模拟退火”的算法来实现,该算法的灵感来自于物理学中的结晶过程。

“要得到晶体结构,”Mahmoodi说,“你把固体加热到很高的温度,然后慢慢冷却。如果你足够慢地冷却它,所有的分子都会找到它们最低能量的位置,最完美的位置,你就会得到一个漂亮的,完全一致的晶体。”

在模拟退火中也使用了类似的方法。“事实上,”Mahmoodi解释道,“当我们开始解决这个问题时,我们使用了太多的噪音——类似于晶体形成时的过高温度。结果表明,神经网络的计算是随机的。然后,我们慢慢减少注入的噪音,同时转向确定性的,或完全可预测的计算,继续晶体形成的类比,这被称为“降低温度”。这一过程提高了网络探索搜索空间的能力,并得出更好的最终解决方案。”

该团队面临的一个大问题是,他们能否建立一个快速、节能、可调节温度(噪音)的随机神经网络。大多数人工神经网络有两个共同点:大量的权值,本质上是网络在训练中学习的可调参数;以及庞大的计算块基础,主要执行乘法和加法运算。

因此,构建高效能、高通量的神经网络,需要在特定区域存储更多信息的设备,以及能够更快、更高效地执行计算的电路。虽然已经有许多关于乘法电路和随机神经元的演示,但将这两种功能结合起来的高效硬件实现仍然缺乏。

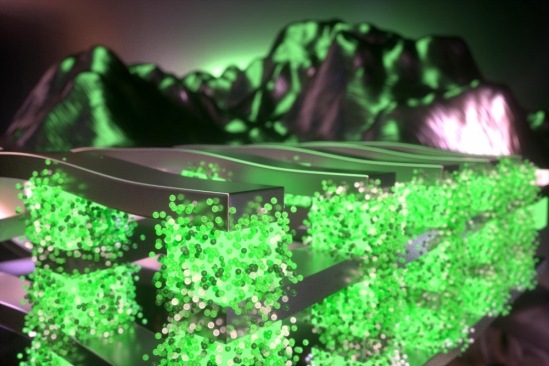

在Strukov实验室,Mahmoodi和其他人正在研究实现神经网络的两个关键的主流技术:忆阻器和嵌入式flash。

“我们很幸运能够在UCSB制造出最先进的模拟忆阻技术,”Mahmoodi说。“每个忆阻器或闪存设备都很小,可以存储5位以上的数据,而SRAM等数字存储器体积大得多,只能存储1位。”因此,我们使用这些更小、更高效的设备来设计混合信号神经网络,它具有模拟和数字电路,因此比纯数字系统更快、更高效。

“事实上,在我们的论文中,我们报告了紧凑、快速、节能和可扩展的随机神经网络电路,它们基于忆阻器或嵌入式闪存,”他补充说。“电路的高性能是由于混合信号(数字和模拟)的实现,而有效的随机操作是通过利用电路的固有噪声实现的。我们证明,我们的电路可以比cpu更快、更高效地解决优化问题。”

新闻旨在传播有益信息,英文原版地址:https://www.news.ucsb.edu/2020/019792/bring-noise