伊萨伊•凯茨曼(Isay Katsman)的20位同事在最近的计算机视觉国际会议(International Conference on Computer Vision)上遇到其他研究人员时,他让他们以为他是一名研究生。

Katsman在10月27日至11月2日于韩国首尔举行的会议上说:“这很简单。“你想要更多地关注材料而不是其他东西。”

他说,让人分心的是,他们的同伴们惊讶地发现,一篇由本科生撰写的论文竟然被这个著名的大会接受了1077篇论文,其中有4303篇是提交的。

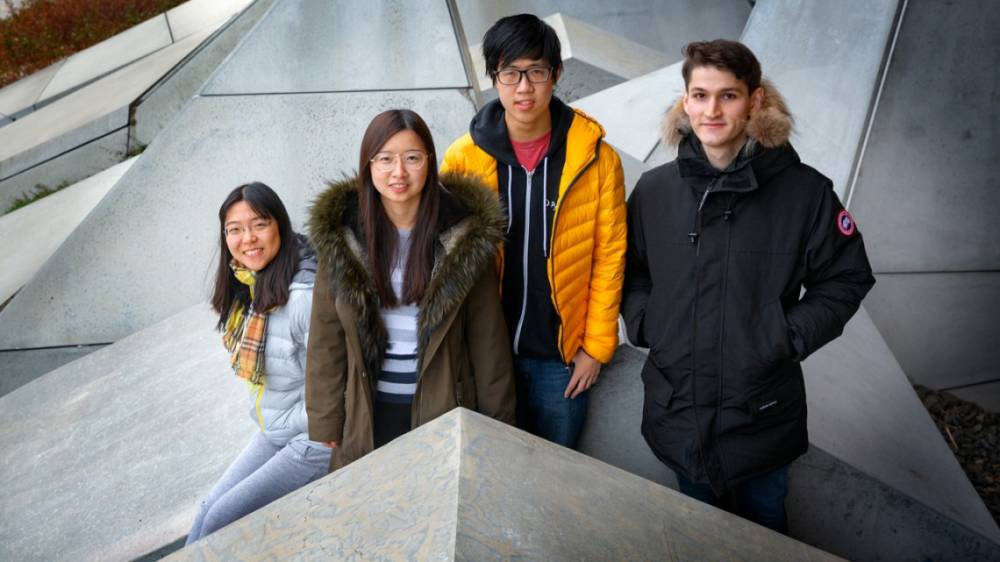

他们的成功是一种荣誉,但并非侥幸:Katsman和第一作者Horace He ‘ 20、Qian Huang ‘ 21和Zeqi Gu ‘ 21都是康奈尔大学视觉与学习俱乐部的成员,该俱乐部成立已有一年,旨在在主要会议上发表机器学习研究。作为与康奈尔科技合作的一部分,他们得到了来自Facebook的设备捐赠的帮助,这使得学生们能够运行他们需要的算法。

“本科生拥有这些资源真是闻所未闻,”康奈尔理工学院计算机科学教授塞尔日·贝隆吉(Serge Belongie)说,他的实验室为学生俱乐部提供资金。贝隆吉正在与Facebook合作一个项目,以打击“深度伪造”——利用人工智能制作的虚假音频和视频——其中约有1万美元专门拨给了本科生研究小组。

该俱乐部用这笔钱购买了图形处理单元——昂贵、功能强大的处理器,这是训练大多数机器学习模型所必需的,一般只对研究生和教员开放。使用中央处理器——这是大多数计算机的运作方式——训练机器学习算法所需的数千或数百万次迭代可能需要数周或数月时间。

“如果你有一个好主意,但你无法验证它,因为计算需要一年的时间,那么你就不能真正做研究,”黄说。“所以现在我们有了完成这项工作所需的工具。”

学生们说,Facebook后来又向该俱乐部捐赠了3万美元,用于购买另外八个图形处理单元。

在他们的论文中,学生们解决了对抗性例子的问题——对一幅人眼无法察觉的图像进行微小的调整,但对于负责对图像进行分类的神经网络来说,这完全是混淆。例如,由黑客或其他怀有恶意的人创建的对抗性示例可能会使自动驾驶汽车失去方向,或破坏图像识别。

学生们考虑的是所谓的可转移性——一个模型的对抗性例子愚弄另一个模型的能力。他们提出并解释了一种增强对抗性例子可转移性的新方法——阐明这种现象是如何发生的,以便更有效地对付它。

Katsman说:“希望这是朝着更好地理解现有机器学习模型的弱点迈出的一步,因为这些模型与真实世界的攻击非常相关。”“我们希望这将最终帮助社区创建强大的模型,抵御这些攻击。”

学生们发现,根据某个神经网络模型层对对抗性的例子进行微调,使其更有可能转移到其他模型;但当他们试图解释他们的方法时,他们发现它的作用与他们最初设想的相反。他们说,这一转变让学生们对研究过程的严谨性有了新的认识。

“我们对它如何工作的最初直觉发生了180度的转变,”黄说。“这是最令人惊讶的部分。”

黄,他和顾是文理学院的数学和计算机科学专业的学生;Katsman是工程学院数学和计算机科学专业的学生。

除了他们的会议报告,学生们还参加了一个海报会议,在那里他们与其他研究人员一对一地讨论他们的工作。“人们来找我们,试图理解我们的工作,我们向他们解释,”顾说。“这让你感觉很好,很多人都想知道我们的研究。”

这篇论文是由Facebook的Belongie和Ser-Nam Lim合著的。计算机科学教授兼主席Kavita Bala和计算机科学助理教授Bharath Hariharan也是学生俱乐部的成员,该俱乐部由Facebook AI赞助。

新闻旨在传播有益信息,英文原版地址:http://news.cornell.edu/stories/2019/11/cs-undergrads-research-sets-sights-image-hackers