随着安全专家和他们的对手开发和适应新的技术,网络安全正在不断发展。在由加州大学圣巴巴拉分校主办的第八届半年一度的加州大学网络安全峰会上,来自安全社区的研究人员、公司和专业人士讨论了该领域的新趋势。

该大学的首席信息安全官萨姆·霍洛维茨(Sam Horowitz)说:“这次会议的目的是提高人们对这些威胁的认识和理解,以及能够抵御这些威胁的技术类型。”

演讲者的话题包括制造、武器化和检测深层假货,这是一个极其重要的问题,尤其是在总统竞选开始的时候。他们还解决了关键基础设施和网络钓鱼的威胁,这是加州大学圣巴巴拉分校今年网络安全意识月活动的重点。

乔瓦尼·维尼亚(Giovanni Vigna)是该校计算机科学教授,也是该校网络安全中心(Center for CyberSecurity)主任,也是该校安全实验室的联合主任。

霍洛维茨说:“乔瓦尼不仅在如何发现威胁方面处于领先地位,而且在如何防范那些阻止你发现威胁的东西方面也处于领先地位。”

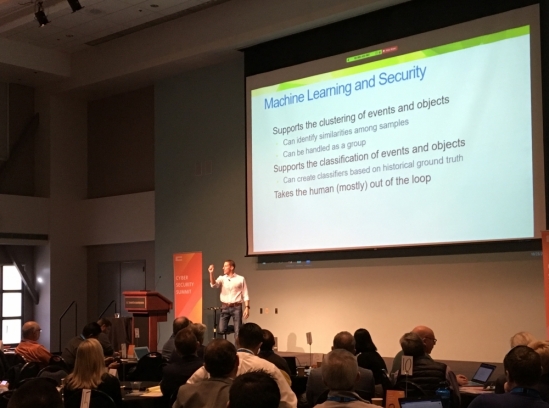

Vigna认为,检测威胁和管理网络安全是一项具有挑战性和耗时的工作。人们期待人工智能使他们的努力自动化和系统化,同时也扩大他们的规模。

他解释说,人工智能可以有效地对电脑活动进行分类,甚至可以学习如何分类,从而简化这些重复性的工作。这使得异常检测在规模、范围和效率上都成为可能,这在上世纪80年代的时候是无法想象的。它甚至可以让安全专家主动出击:主动收集情报,并开发工具,以应对他们的网络还没有经历过的攻击。

但人工智能并不是我们安全挑战的明确解决方案。“问题是这些技术是在不安全的领域开发的,”Vigna说。“在图像识别和自然语言处理方面,最有效的机器学习算法已经被开发出来。

“你猜怎么着,这些环境不是对抗性的,”他继续说。“在安全领域,你把这些算法应用到一个领域,在这个领域里,你的对手实际上在努力阻止你捕捉他们的行为。”

恶意的行动者以运行能迷惑AI的阴险的假旗攻击而闻名。

“更重要的是,对手可能会污染你正在学习的数据集,”维尼亚说,就像放诱饵一样。作为一个类比,他提到了那些在Facebook上发布的图片中将没有生命的物体标记为人的滑稽行为。这损害了公司软件用于学习的数据。

将人工智能纳入网络安全并不能改变这样一个事实:安全人员仍然需要保护他们的方法不受攻击。事实上,机器学习使这一点更加重要,也更加困难。

研究人员发现了一个漏洞,可以让一个人窃取系统学到的东西。它基本上是一种逆向工程技术,一种基于它提供的答案的人工智能算法。维尼亚说:“如果我能像一个神谕师一样询问你对我的数据的看法,以及你学到了什么,那么我就能窃取你学过的任何东西。”

他补充道:“在我的实验室里,我们正以多种不同的方式专注于机器学习,而不仅仅是抓东西。”“例如,我们使用机器学习来识别代码的哪些部分更容易包含漏洞。”

人工智能的使用不会结束网络安全的挑战。人工智能只是另一种工具,其效果的好坏取决于使用者的意图。“坏人也在使用人工智能,”维尼亚指出。

他还警告说,安全社区倾向于假设异常活动对应于恶意活动。但事实未必如此。一些攻击看起来是无害的,而另一些正常的活动看起来是可疑的。将人工智能异常检测与人类建立的系统相结合,以区分好的和坏的行为,似乎提供了这两种技术的最佳效果。

人类仍然是网络安全的重要组成部分。维尼亚说:“你可以使用人工智能来提高话语水平,但某些决定仍然需要人类来解释和创造语境,以充分应对威胁。”我们是对我们的软件的发现做出价值判断的人。

霍洛维茨也有同感。他说:“我们今天在这里的真正原因是要让人类有能力在一个更复杂的对手和更复杂的自动防御系统中发挥作用。”“通过这种方式,我们可以保护我们自己和我们的组织。”

新闻旨在传播有益信息,英文原版地址:https://www.news.ucsb.edu/2019/019683/changing-face-cyber-security